Papers·5일 전

V-GRPO: 확산 모델 정렬을 위한 변분 GRPO — ELBO 기반 RL로 2~3배 속도 향상

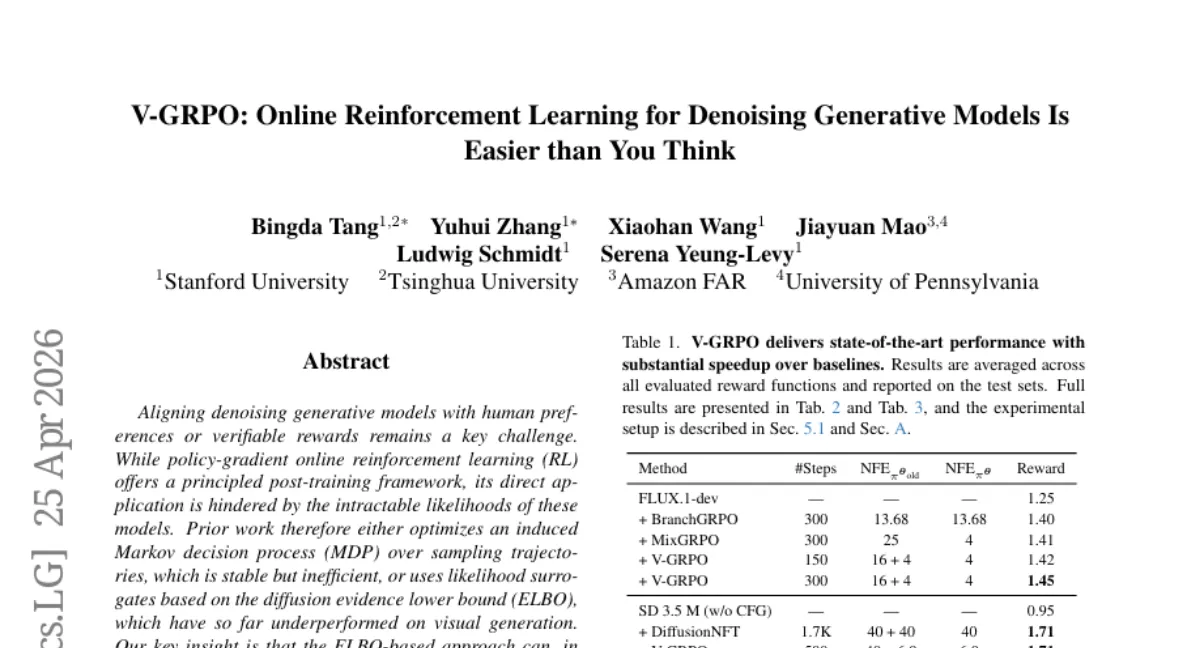

Stanford 팀이 확산 생성 모델을 사람 선호나 보상 함수에 정렬하는 새로운 RL 방법 V-GRPO를 제안했습니다. 기존 MDP 기반 방법은 안정적이지만 비효율적이고, ELBO 기반 방법은 성능이 낮았는데, V-GRPO는 surrogate 분산을 줄이고 gradient step을 제어해 두 문제를 동시에 해결합니다. Text-to-image 합성에서 SOTA를 달성했으며, MixGRPO 대비 2배, DiffusionNFT 대비 3배 빠른 학습 속도를 보여줍니다. 단, 이 방법은 reward 모델이 미리 학습되어 있어야 하고, diffusion 모델의 ELBO 계산이 추가로 필요하다는 점을 고려해야 합니다.

- #diffusion

- #rl

- #alignment

- #stanford

- #text-to-image

Stanford University