Hypes·8개월 전

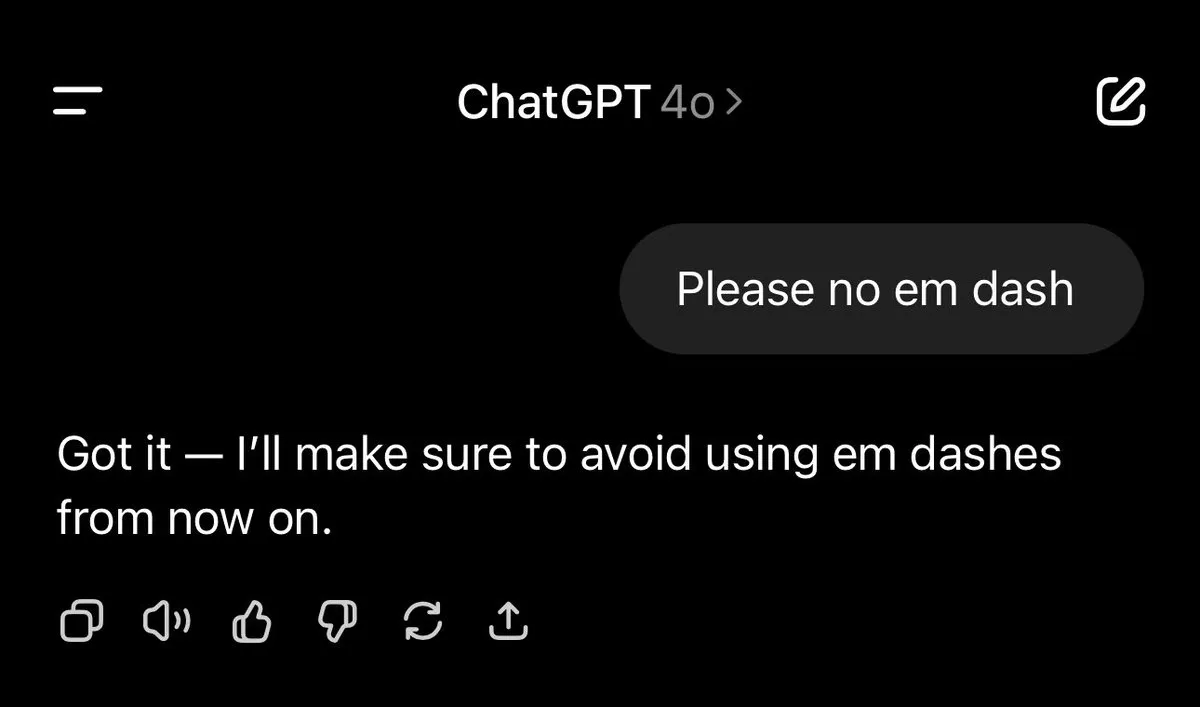

Jim Fan "no em dash should be baked into pretraining" — LLM identity hardwired

Jim Fan이 "em dash(긴 대시)는 pretraining, post-training, alignment, system prompt 등 LLM 생애주기 모든 구석에 구워져야 하며, 모델의 커널·정체성·존재 자체에 하드와이어되어야 한다"고 주장했다. 이는 단순한 문장 부호 논쟁을 넘어, 모델의 근본적인 행동 특성을 데이터나 파인튜닝이 아닌 아키텍처 수준에서 고정해야 한다는 신호로 읽힌다. 최근 모델 정렬 논의가 세밀해지는 흐름 속에서, 'soft' 방식 대신 'hardwired' 접근을 강조한 점이 눈에 띈다.

- #jimfan

- #llm

- #alignment

- #model-architecture

Jim Fan@DrJimFan