Papers·4일 전

OSCAR: LVLM 환각 줄이기 위한 온라인 자기 교정 프레임워크 — GPT 의존 없이 벤치마크 SOTA

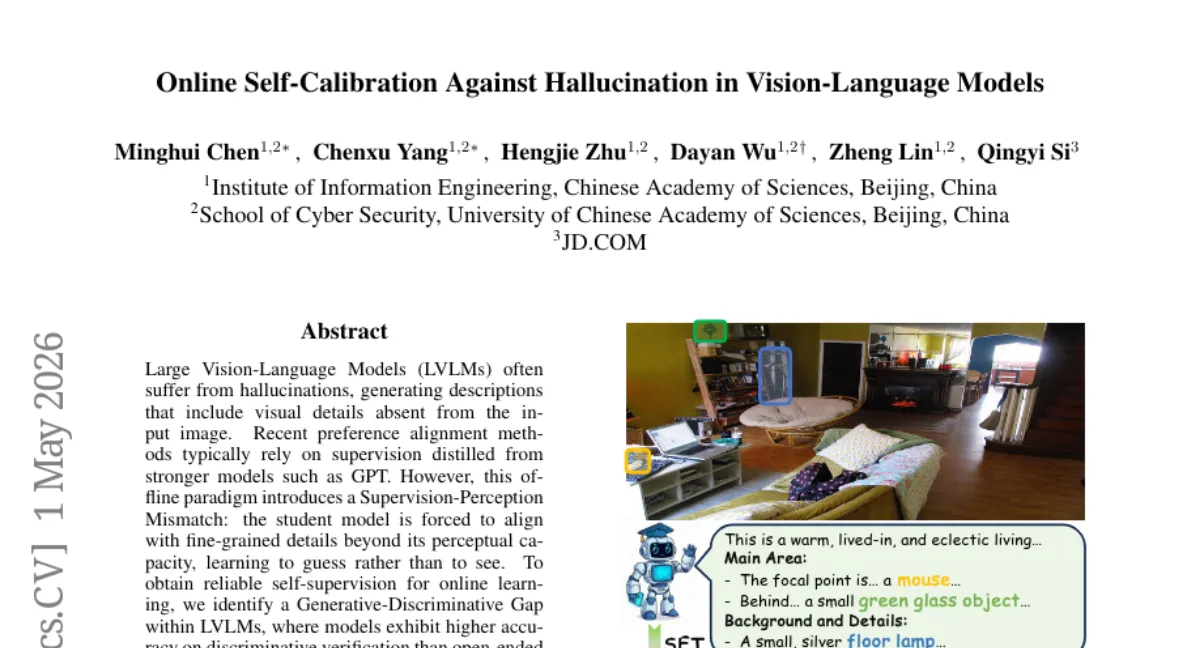

LVLM이 이미지에 없는 내용을 생성하는 환각 문제를 해결하기 위해, OSCAR 프레임워크가 제안됐습니다. 핵심은 생성-판별 격차를 활용해 모델 자체가 온라인으로 선호 데이터를 구축하는 점 — Monte Carlo Tree Search와 이중 세분화 보상 메커니즘으로 직접 선호 최적화(DPO)를 반복 수행합니다. GPT 같은 외부 교사 없이도 환각 벤치마크에서 SOTA를 달성했으며, 일반 멀티모달 능력도 함께 개선됐습니다. 다만 실험은 주로 7B/13B 규모 모델에 한정되었고, 계산 비용이 기존 오프라인 방식보다 높을 수 있습니다.

- #lvlms

- #hallucination

- #self-calibration

- #dpo

- #mcts

Minghui Chen