Papers·어제

언어 모델 병합의 스케일링 법칙 — 전문가 수와 모델 크기에 따른 교차 엔트로피 감소 예측

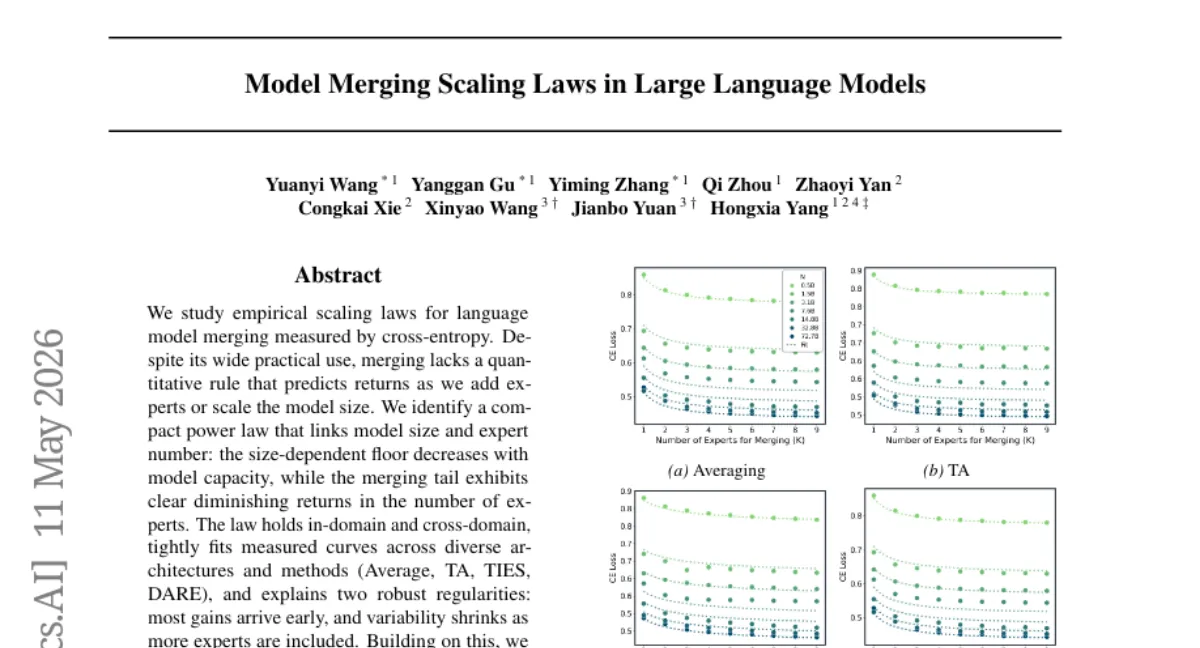

홍콩 폴리텍대 연구팀이 언어 모델 병합(merging)의 스케일링 법칙을 교차 엔트로피 기준으로 규명했습니다. 모델 크기가 클수록 손실 하한(floor)은 낮아지고, 전문가 수 증가에 따른 이득은 1/k에 가깝게 체감한다는 멱법칙(power law)이 다양한 아키텍처와 병합 방법(Average, TA, TIES, DARE)에서 성립합니다. 이 법칙을 바탕으로 목표 손실 달성에 필요한 전문가 수 추정, 추가 중단 시점 결정, 고정 예산 하에서 모델 확장과 전문가 추가 간 트레이드오프 계산이 가능해져, 병합을 경험적 기법에서 예측 가능한 계획 도구로 전환합니다. 단, 실험은 최대 7B 모델과 8개 전문가로 제한되어 더 큰 스케일에서의 검증이 필요합니다.

- #model-merging

- #scaling-laws

- #language-models

- #polyu

The Hong Kong Polytechnic University