arXiv·연구

Papers

Papers·2일 전

Papers·2일 전WorldReasonBench: 비디오 생성 모델의 세계 추론 능력을 평가하는 새로운 벤치마크

UniX Lab이 비디오 생성 모델이 단순한 시각적 그럴듯함을 넘어 물리·사회·논리·정보적 일관성을 갖춘 세계 상태 예측을 수행하는지 평가하는 WorldReasonBench를 공개했습니다. 436개의 테스트 케이스와 4가지 추론 차원, 22개 하위 범주로 구성되며, 생성된 비디오는 과정 인식 검증과 다차원 품질 평가로 분석됩니다. 현대 비디오 생성기들은 시각적 그럴듯함과 세계 추론 사이에 지속적인 격차를 보였으며, 코드와 데이터셋은 GitHub에 공개될 예정입니다.

- #video-generation

- #benchmark

- #world-reasoning

- #unix-lab

UniX Lab

Papers·2일 전

Papers·2일 전PaperFit — LaTeX PDF 시각 최적화 에이전트, 200개 논문에서 결함 41% 개선

OpenDataLab 팀이 LaTeX 논문 PDF의 시각적 결함(그림 위치 오류, 수식 넘침, 표 크기 불일치 등)을 자동으로 수정하는 비전-인-더-루프 에이전트 PaperFit을 공개했습니다. 컴파일 가능한 소스에서 publication-ready PDF로 가는 과정을 Visual Typesetting Optimization(VTO)으로 정식화하고, 5개 카테고리 13종 결함 분류 체계를 제시했습니다. PaperFit-Bench(200개 논문, 10개 템플릿) 평가에서 모든 베이스라인을 큰 폭으로 앞질렀지만, 각 결함 수정에 여러 번의 시각 렌더링이 필요해 compute cost가 높은 점은 한계입니다.

- #latex

- #typesetting

- #vision-in-the-loop

- #opendatalab

OpenDataLab

Papers·2일 전

Papers·2일 전Mela: 인간 뇌의 기억 통합 원리를 모방한 계층형 메모리 모듈 — 4K 학습 길이 대비 32K까지 성능 유지

뇌의 기억 통합(memory consolidation) 원리에서 영감을 받아, 서로 다른 업데이트 주파수로 동작하는 두 개의 서브모듈로 구성된 Hierarchical Memory Module(HMM)을 제안했습니다. 저주파 서브모듈은 추상적인 개괄 지식을, 고주파 서브모듈은 풍부한 일화적 세부 정보를 포착하며, 문맥에 따라 동적으로 재구성됩니다. HMM을 Transformer 기반 언어 디코더에 통합한 Mela 모델군은 모든 크기에서 Transformer 베이스라인을 능가했으며, 4K로 사전학습된 컨텍스트 길이를 고정한 상태에서도 32K까지 성능 저하 없이 추론 가능했습니다. 단, ablation 결과가 특정 설정에 민감할 수 있어 실용적 구성 시 추가 검증이 필요합니다.

- #memory

- #language-model

- #transformer

- #neuroscience

Musubi

Papers·2일 전

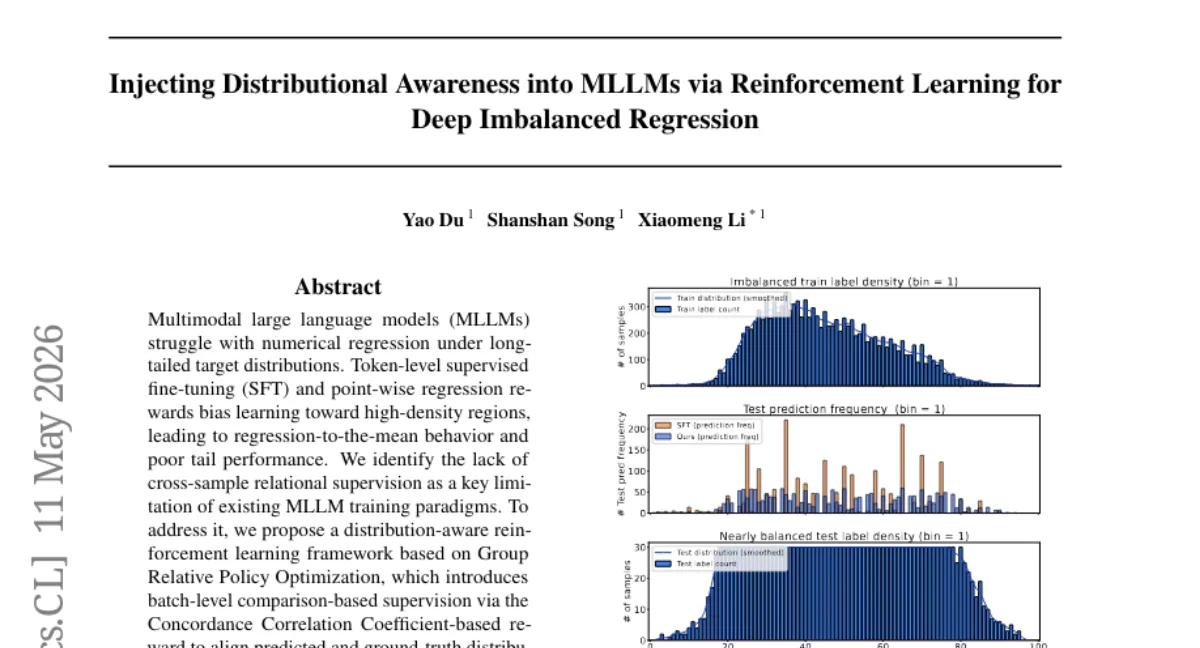

Papers·2일 전분포 인식 RL로 MLLM 장꼬리 회귀 성능 개선 — CCC 보상 기반 Group Relative Policy Optimization

MLLM이 장꼬리 분포를 가진 수치 회귀 태스크에서 평균 회귀 편향을 보이는 문제를 해결하기 위해, batch 수준의 비교 기반 학습을 도입한 분포 인식 강화학습 프레임워크를 제안했습니다. Concordance Correlation Coefficient 기반 보상을 통해 예측 분포와 실제 분포의 상관·스케일·평균을 정렬하며, 중간·소수 샷 영역에서 특히 큰 개선을 보였습니다. 아키텍처 수정이 필요 없는 플러그-앤-플레이 방식이지만, 실험은 통합 장꼬리 회귀 벤치마크에 국한되어 있습니다.

- #mllm

- #regression

- #reinforcement-learning

- #long-tail

Yao Du

Papers·2일 전

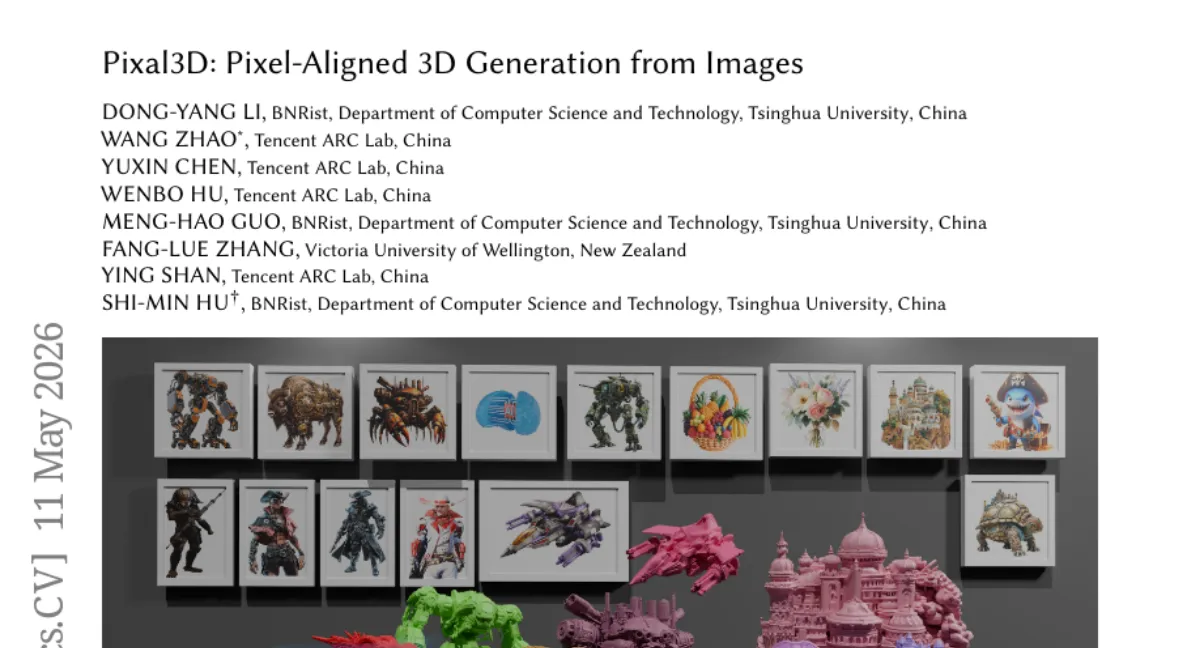

Papers·2일 전Tencent PCG, 픽셀 정렬 3D 생성 Pixal3D — 단일 이미지에서 재구성 수준의 충실도 달성

Tencent PCG 팀이 단일 이미지로부터 3D 에셋을 생성할 때 픽셀 단위 충실도를 크게 개선한 Pixal3D를 공개했습니다. 기존 3D 생성기는 정규 공간에서 형상을 생성하고 이미지 정보를 attention으로 주입해 2D-3D 대응이 모호했지만, Pixal3D는 입력 시점과 정렬된 픽셀 역투영 기법으로 직접 대응을 설정합니다. 멀티뷰 생성과 장면 합성으로도 확장 가능하며, 재구성 수준에 근접한 충실도를 보여주지만 대규모 학습 데이터와 연산량이 필요하다는 조건이 붙습니다.

- #3d-generation

- #pixel-aligned

- #tencent

- #image-to-3d

ARC Lab, Tencent PCG

Papers·2일 전

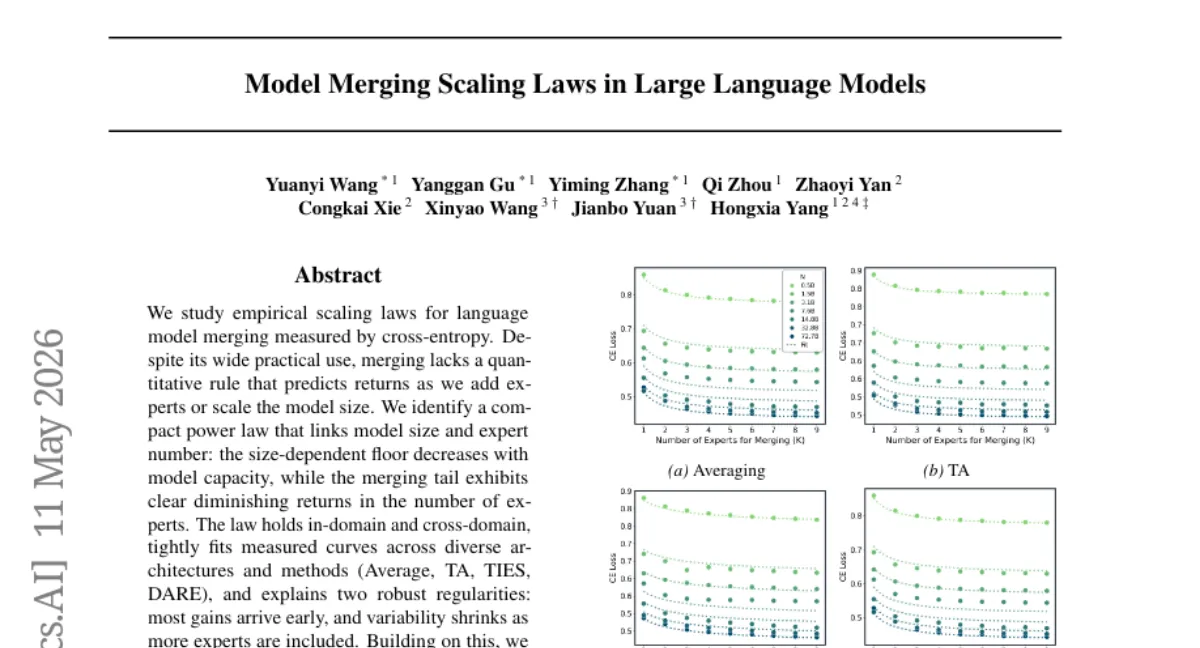

Papers·2일 전언어 모델 병합의 스케일링 법칙 — 전문가 수와 모델 크기에 따른 교차 엔트로피 감소 예측

홍콩 폴리텍대 연구팀이 언어 모델 병합(merging)의 스케일링 법칙을 교차 엔트로피 기준으로 규명했습니다. 모델 크기가 클수록 손실 하한(floor)은 낮아지고, 전문가 수 증가에 따른 이득은 1/k에 가깝게 체감한다는 멱법칙(power law)이 다양한 아키텍처와 병합 방법(Average, TA, TIES, DARE)에서 성립합니다. 이 법칙을 바탕으로 목표 손실 달성에 필요한 전문가 수 추정, 추가 중단 시점 결정, 고정 예산 하에서 모델 확장과 전문가 추가 간 트레이드오프 계산이 가능해져, 병합을 경험적 기법에서 예측 가능한 계획 도구로 전환합니다. 단, 실험은 최대 7B 모델과 8개 전문가로 제한되어 더 큰 스케일에서의 검증이 필요합니다.

- #model-merging

- #scaling-laws

- #language-models

- #polyu

The Hong Kong Polytechnic University

Papers·2일 전

Papers·2일 전Qwen-Image-2.0: 통합 이미지 생성·편집 모델 — 긴 텍스트·다국어·포토리얼리즘 개선

Qwen 팀이 고품질 이미지 생성과 정밀 편집을 하나의 프레임워크로 통합한 Qwen-Image-2.0을 공개했습니다. Qwen3-VL을 조건 인코더로, Multimodal Diffusion Transformer를 결합해 최대 1K 토큰의 복잡한 지시를 처리하며, 슬라이드·포스터·인포그래픽 등 텍스트가 많은 콘텐츠에서 다국어 타이포그래피 충실도가 크게 향상되었습니다. 포토리얼리스틱 생성에서도 디테일·질감·조명이 개선되었고, 사람 평가에서 이전 Qwen-Image 대비 생성과 편집 모두에서 우세를 보였습니다. 다만 학습 데이터 규모와 추론 비용에 대한 세부 정보는 공개되지 않아 재현성은 제한적입니다.

- #image-generation

- #image-editing

- #multimodal

- #qwen

Qwen

Papers·2일 전

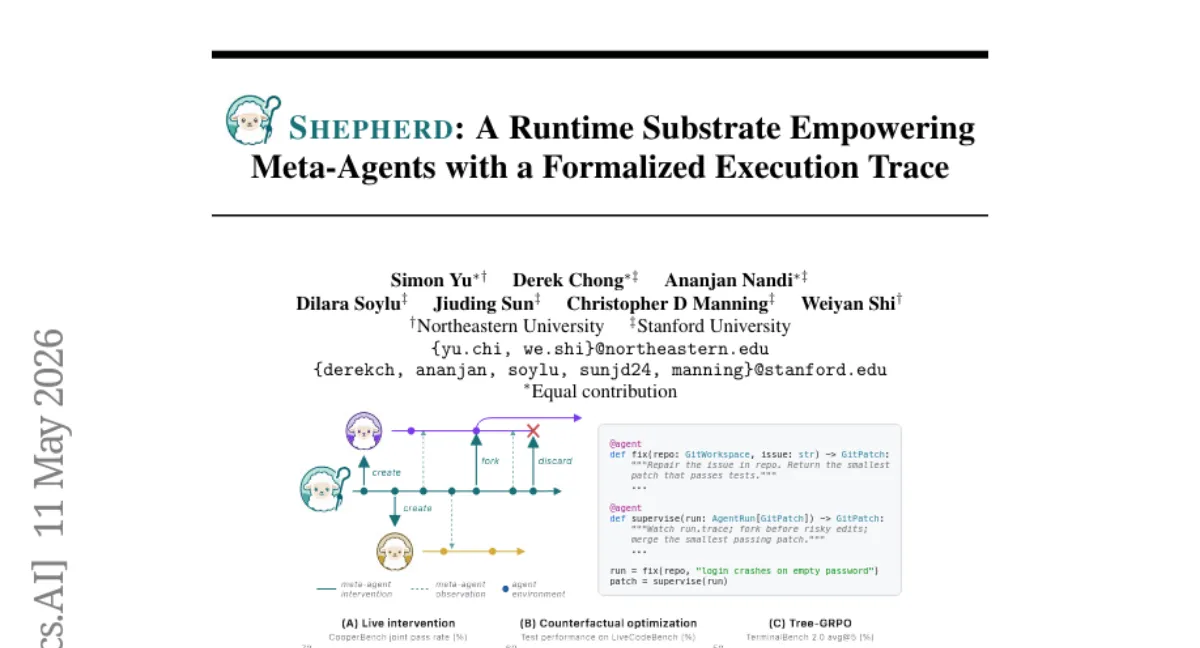

Papers·2일 전Shepherd: 함수형 메타 에이전트 프레임워크 — 포크·재생 5x 빠르고 프롬프트 캐시 재사용 95% 이상

Shepherd는 메타 에이전트가 타겟 에이전트를 함수처럼 조작할 수 있게 하는 함수형 프로그래밍 모델로, Lean에서 핵심 연산이 기계적으로 증명되었습니다. Git과 유사한 실행 트레이스에 모든 상호작용을 기록해 과거 상태를 포크·재생할 수 있으며, Docker 대비 5배 빠른 포크 속도와 95% 이상의 프롬프트 캐시 재사용률을 달성했습니다. CooperBench에서 실시간 감독이 pair coding 통과율을 28.8%에서 54.7%로 높였고, 반사실적 메타 최적화에서 4개 벤치마크에서 최대 11포인트 향상 및 58% 시간 단축, Tree-RL 훈련에서 TerminalBench-2 성능을 34.2%에서 39.4%로 개선했습니다. 단, Lean 증명은 특정 연산에 국한되며 전체 시스템의 정확성을 완전히 보장하지는 않습니다.

- #meta-agent

- #functional-programming

- #lean

- #fork

Simon Yu

Papers·2일 전

Papers·2일 전NanoResearch: 다중 에이전트 연구 자동화에 개인화 도입 — 사용자 선호 학습으로 3단계 공진화

NanoResearch는 LLM 기반 다중 에이전트 시스템에 개인화를 도입한 프레임워크로, 기존 시스템 대비 연구 품질과 비용 효율에서 유의미한 개선을 보였습니다. 핵심은 세 가지 메커니즘의 공진화: 스킬 뱅크가 프로젝트 간 재사용 가능한 절차 지식을 축적하고, 메모리 모듈이 사용자별 경험을 유지하며, 레이블 없는 피드백 학습이 암묵적 선호를 정책 파라미터로 내재화합니다. 다만 실험 환경이 공개되지 않아 재현성과 실제 연구 워크플로우에서의 일반화 가능성은 추가 검증이 필요합니다.

- #multi-agent

- #personalization

- #research-automation

- #llm

Jinhang Xu

Papers·2일 전

Papers·2일 전Microsoft, RLVR에 역방향 자기-증류 도입 — RLRT가 Qwen3에서 기존 대비 최대 8% 개선

Microsoft Research가 자기-증류(self-distillation)의 신호를 역으로 읽어, 학생 모델이 성공한 토큰을 강화하는 RLRT(RLVR with Reversed Teacher)를 제안했습니다. 기존 자기-증류가 실패 시 도움을 주지만 성공 시 학생의 추론을 덮어쓰는 문제를 해결, GRPO에 역방향 교사 신호를 추가해 유용한 탐색을 유도합니다. Qwen3의 base, instruction-tuned, thinking-tuned 체크포인트에서 기존 자기-증류 및 탐색 기반 방법을 일관되게 능가했으며, 정보 비대칭을 RLVR의 새로운 설계 축으로 제시한 점이 흥미롭습니다.

- #self-distillation

- #rlvr

- #grpo

- #microsoft

Microsoft Research

Papers·2일 전

Papers·2일 전딥페이크 탐지기의 본질은 알파 블렌딩 검색 — BlenD, 앙상블 AUROC 94.0%

최신 딥페이크 탐지기가 교차 데이터셋 일반화를 보이지만, 그 메커니즘은 사실 저수준 합성 아티팩트(알파 블렌딩)를 찾는 데 가깝다는 '알파 블렌딩 가설'을 제시합니다. 저자들은 실제 얼굴 이미지에 Self-Blended Image(SBI) 증강을 적용한 BlenD 방법을 제안했고, 2019~2025년 15개 딥페이크 데이터셋에서 평균 최고 일반화 성능을 달성했습니다. 특히 블렌딩 탐지기와 블렌딩에 강건한 모델의 예측이 상호 보완적이어서, 앙상블 AUROC 94.0%를 기록했습니다. 코드와 모델은 공개 예정입니다.

- #deepfake-detection

- #alpha-blending

- #generalization

- #ensemble

Andrii Yermakov

Papers·2일 전

Papers·2일 전SLIM: 동적 스킬 생애주기 관리로 에이전트 RL 성능 7.1%p 향상

홍콩중문대 연구팀이 에이전트 RL에서 외부 스킬 세트를 동적으로 최적화하는 프레임워크 SLIM을 제안했습니다. 기존 연구는 스킬이 영구적으로 축적되거나 정책에 내재화된다고 가정했지만, SLIM은 leave-one-skill-out 검증으로 각 스킬의 한계 기여도를 측정해 유지·퇴직·확장 세 가지 생애주기 연산을 적용합니다. ALFWorld와 SearchQA에서 최대 7.1%p 향상되었으며, 일부 스킬은 정책에 흡수되고 일부는 외부 가치를 계속 제공하는 혼합 패턴을 보였습니다. 단, 실험 환경이 제한적이고 스킬 단위의 정의에 따라 결과가 달라질 가능성이 있습니다.

- #reinforcement-learning

- #agent

- #skill-management

- #cuhk

The Chinese University of Hong Kong - Database Group

Papers·2일 전

Papers·2일 전Omni-Persona: 최초의 전모달 개인화 벤치마크 — 텍스트·이미지·오디오 통합 평가

서울대 연구팀이 텍스트, 이미지, 오디오를 모두 포함하는 전모달 개인화 벤치마크 Omni-Persona를 공개했습니다. 4개 태스크 그룹, 18개 세부 태스크, 약 750개 아이템으로 구성되며, 부재-페르소나 쿼리를 포함한 Calibrated Accuracy(Cal) 지표로 접지(grounding) 행동을 진단합니다. 실험 결과, 오픈소스 모델은 오디오-비주얼 접지 격차를 보이며 RLVR이 이를 일부 개선하지만 보수적 행동으로 수렴하고, SFT는 대규모 정답 데이터 구성의 한계를 드러냅니다. 흥미로운 포인트는 정답률과 파라미터 규모만으로는 환각과 캘리브레이션을 예측할 수 없다는 점입니다.

- #personalization

- #benchmark

- #multimodal

- #seoul-national-university

Seoul National University

Papers·2일 전

Papers·2일 전G-Zero: 검증기 없이 LLM 스스로 진화하는 공동진화 프레임워크

G-Zero는 외부 검증기 없이 LLM이 스스로 진화할 수 있는 공동진화 프레임워크입니다. Hint-δ라는 내재적 보상을 통해 Proposer가 Generator의 약점을 공략하는 질문과 힌트를 생성하고, Generator는 DPO로 이를 내재화합니다. 이론적으로 최적화 보장을 증명했으며, 검증 불가능한 영역에서도 확장 가능한 자기 진화 경로를 제시합니다. 다만 실험 결과가 아직 공개되지 않아 실제 성능은 확인이 필요합니다.

- #self-evolution

- #llm

- #co-evolution

- #grpo

Chengsong Huang

Papers·3일 전

Papers·3일 전Scratchpad Patching: 토크나이저 없는 언어모델의 패치 크기-품질 트레이드오프 해결

토크나이저 없이 바이트 단위로 동작하는 언어모델에서 패치 크기와 품질 간 트레이드오프를 해결하는 Scratchpad Patching(SP) 기법이 제안됐습니다. 패치 내부에 transient scratchpad를 삽입해 지금까지 본 바이트를 집계하고 패치 수준 컨텍스트를 갱신함으로써, 패치 지연(patch lag) 문제를 완화합니다. 16바이트/패치 설정에서 SP를 적용한 모델은 바이트 수준 베이스라인과 동등한 품질을 유지하면서 KV 캐시를 16배, 추론 연산량을 3~4배 줄였습니다. 단, scratchpad 연산이 추가로 필요해 엔지니어링 최적화가 더 필요할 수 있습니다.

- #tokenizer-free

- #scratchpad-patching

- #byte-level

- #language-modeling

Lin Zheng

Papers·3일 전

Papers·3일 전SimWorld Studio: Unreal Engine 5 기반의 자가진화형 3D 환경 생성 플랫폼 — embodied agent 성공률 18포인트 향상

Haoqiang Kang 팀이 Unreal Engine 5 위에 구축한 오픈소스 플랫폼 SimWorld Studio를 공개했습니다. SimCoder라는 코드 에이전트가 언어/이미지 지시로부터 물리 기반 3D 환경을 생성하고, 컴파일 오류나 VLM 비평 등 verifier 피드백으로 자가진화합니다. 생성된 환경은 Gym 스타일 인터페이스로 제공되며, embodied agent의 성능 피드백을 받아 난이도를 조절하는 공진화(co-evolution)를 통해 세 가지 내비게이션 태스크에서 고정 환경 대비 성공률 18포인트, 미학습 에이전트 대비 40포인트 향상을 보였습니다. 다만 Unreal Engine 5 의존성과 생성 환경의 benchmark 일반화 범위는 추가 검증이 필요합니다.

- #embodied-ai

- #simulation

- #unreal-engine

- #open-source

Haoqiang Kang

Papers·3일 전

Papers·3일 전PolyU, LLM 지속적 후학습에서 망각 원인 규명 — 기하학 충돌 기반 GCWM 으로 데이터 없이 성능 개선

홍콩폴리텍대 연구팀이 LLM 지속적 후학습(continual post-training)에서 망각(forgetting)이 발생하는 원인을 파라미터 업데이트의 공분산 기하학(covariance geometry) 불일치로 설명하고, 이를 해결하는 데이터 프리 방법 GCWM(Geometry-Conflict Wasserstein Merging)을 제안했습니다. GCWM은 가우시안 Wasserstein barycenter로 공유 메트릭을 구성하고 기하학 충돌(geometry conflict)을 게이트로 삼아 보정을 적용합니다. Qwen3 0.6B~14B 모델에서 도메인·능력 지속 설정 모두 데이터 프리 baseline을 일관되게 상회했으며, 재현 데이터 없이도 망각을 줄이고 최종 성능을 높였습니다. 다만 실험 규모가 14B까지로 제한되고, replay 기반 방법과의 비교는 포함되지 않았습니다.

- #continual-learning

- #catastrophic-forgetting

- #llm

- #geometry

The Hong Kong Polytechnic University

Papers·3일 전

Papers·3일 전Yale, 글로벌 학습 기반 KV eviction — 전체 캐시보다 성능 개선

Yale 팀이 글로벌 retention 기반 KV eviction 방법을 제안했습니다. 각 토큰의 미래 유용성을 학습해 제한된 메모리 예산 내에서 캐시를 관리하며, 긴 문맥 추론에서 전체 캐시를 사용할 때보다 오히려 성능이 향상되는 경우가 있음을 보였습니다. 이는 불필요한 토큰이 attention을 희석하는 현상을 줄이기 때문으로, 다양한 long-context 언어·비전-언어·멀티턴 대화 벤치마크에서 KV 메모리를 크게 줄이면서도 전체 캐시와 동등하거나 더 나은 결과를 냈습니다. 다만 이 방법은 학습 가능한 retention 게이트와 공유 scoring projection이 필요해 추가 학습 비용이 듭니다.

- #kv-cache

- #long-context

- #attention

- #yale

Yale University

Papers·3일 전

Papers·3일 전ROMA: 강화학습 기반 MLLM 추론 강건성 향상 — 시각적 열화에도 정확도 유지

Tencent Hunyuan 팀이 시각적 열화(블러, 압축, 저해상도)에 강건한 MLLM 추론을 위한 RL 미세조정 프레임워크 ROMA를 제안했습니다. 기존 방법은 열화된 입력을 rollout에 직접 사용하면 보상 중독을 일으키지만, ROMA는 이중 순전파 전략으로 깨끗한 이미지의 궤적을 기준으로 열화된 뷰를 평가하고, 토큰 수준의 surrogate KL 패널티와 정답 조건부 정규화를 통해 정책 붕괴 없이 강건성을 학습합니다. Qwen3-VL 4B/8B 모델에서 GRPO 대비 기존 열화 +2.4%, 미지의 열화 +2.3% 향상되었으며, 깨끗한 입력 정확도는 유지했습니다. 다만 8B 모델 기준 8×A100 환경에서 학습되었다는 점은 참고할 만합니다.

- #reinforcement-learning

- #multimodal

- #robustness

- #tencent

Tencent Hunyuan

Papers·3일 전

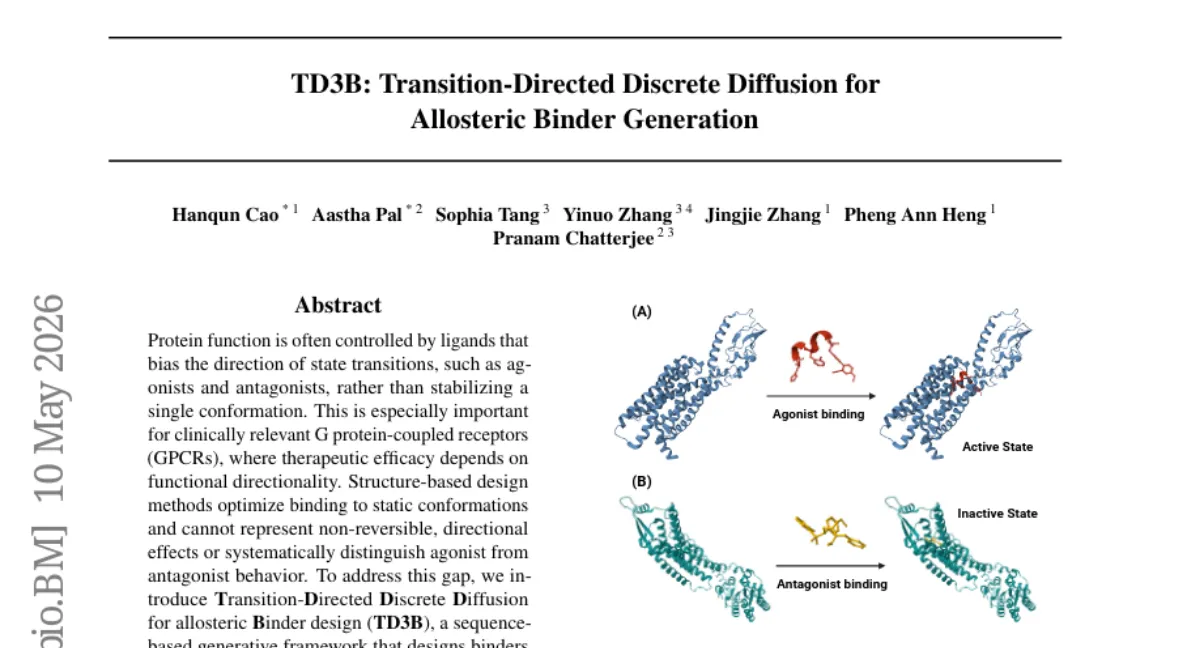

Papers·3일 전TD3B: GPCR 작용제/길항제 설계를 위한 전이-지향 이산 확산 모델

ChatterjeeLab 팀이 GPCR 단백질에 대해 작용제(agonist) 또는 길항제(antagonist) 기능을 명시적으로 지정할 수 있는 시퀀스 기반 생성 프레임워크 TD3B를 공개했습니다. 기존 구조 기반 설계는 정적 구조에 최적화되어 방향성을 반영하지 못했지만, TD3B는 방향 전이 제어 목적 함수(Directional Transition Control Objective)를 도입해 결합 친화도와 무관하게 원하는 기능을 가진 바인더를 생성합니다. 코드와 체크포인트는 허깅페이스에 공개되어 있습니다.

- #gpcrs

- #protein-design

- #diffusion

- #drug-discovery

Programmable Biology Group

Papers·3일 전

Papers·3일 전Sub-JEPA: 랜덤 부분공간 가우시안 제약으로 JEPA 세계모델 편향-분산 균형 개선

Shanghai University 연구팀이 JEPA 기반 세계모델의 학습 안정성과 표현 유연성 사이 균형을 개선한 Sub-JEPA를 제안했습니다. 기존 LeWorldModel이 고차원 원본 공간에 등방성 가우시안 사전을 부과해 과도한 편향을 유발한 반면, Sub-JEPA는 여러 랜덤 부분공간에서 가우시안 제약을 적용해 전역 제약을 완화하면서도 붕괴 방지 효과를 유지합니다. 4가지 연속 제어 환경 실험에서 LeWM을 명확한 차이로 능가했으며, 코드는 공개되었습니다.

- #world-models

- #jepa

- #representation-learning

- #shanghai-university

shanghai university

Papers·3일 전

Papers·3일 전DeltaRubric: 계획-실행 2단계로 MLLM 보상 모델 정확도 +22.6%p 개선

Tencent Hunyuan 팀이 MLLM 정렬을 위한 보상 모델의 '게으른 판단(lazy judging)' 문제를 해결하는 DeltaRubric을 제안했습니다. 기존 단일 단계 평가자는 언어 priors에 의존해 시각적 세부 검증을 소홀히 하는데, DeltaRubric은 불일치 계획자(Disagreement Planner)가 인스턴스별 검증 체크리스트를 생성하고, 체크리스트 검증자(Checklist Verifier)가 이를 실행하는 2단계 구조로 평가를 분해합니다. Qwen3-VL 4B/8B 모델에 적용한 결과, VL-RewardBench에서 각각 +22.6%, +18.8%의 정확도 향상을 보였습니다. 다만 4B/8B 소형 모델에만 검증되었고, 대형 모델에서의 일반화는 추가 실험이 필요합니다.

- #mllm

- #reward-model

- #alignment

- #tencent

Tencent Hunyuan

Papers·3일 전

Papers·3일 전Bayesian 구조적 디코딩 — DLM에서 유연한 길이 생성, 학습 없이 품질 개선

확산 언어 모델(DLM)의 유연한 길이 생성을 위해 Bayesian 구조적 디코딩 프레임워크를 제안했습니다. 기존 방식은 고정 길이에 의존하거나 지역적 신호만 사용해 품질이 떨어졌는데, 이 방법은 확장 길이, 블록 경계, 디코딩 스케줄을 동시에 추론하며 지역 불확실성과 구조적 신호를 통합합니다. 여러 벤치마크에서 기존 고정/유연 길이 기준 대비 생성 품질과 유연성이 크게 향상되었으며, 재학습이 필요 없어 실용적입니다.

- #diffusion-language-models

- #flexible-length-generation

- #bayesian-decoding

- #structured-generation

Bian Sun

Papers·4일 전

Papers·4일 전RigidFormer: 메시 없이 강체 동역학을 학습하는 Transformer — 200개 이상 객체, 2배 빠른 추론

MIT 연구진이 메시 없이 포인트 클라우드 입력만으로 강체 동역학을 학습하는 Transformer 모델 RigidFormer를 공개했습니다. 객체 단위로 동작하며 Anchor-Vertex Pooling과 Anchor-based RoPE로 접촉 형상을 유지하고, differentiable Kabsch 정렬로 강체성을 강제합니다. 표준 벤치마크에서 메시 기반 베이스라인 대비 속도는 2배 빠르고, 200개 이상 객체로 일반화되며, 보지 못한 포인트 해상도와 데이터셋에도 잘 전이됩니다. 다만 학습 기반 접근의 특성상 시뮬레이션 정확도는 물리 엔진 대비 떨어질 수 있고, 커맨드 조건부 관절체는 예비 실험 단계입니다.

- #rigid-body-dynamics

- #transformer

- #mesh-free

- #mit

Massachusetts Institute of Technology

Papers·4일 전

Papers·4일 전IDEA-XL, SGRPO 공개 — 분자 생성에서 utility-diversity Pareto frontier 확장

IDEA-XL 팀이 Supergroup Relative Policy Optimization (SGRPO)을 제안했습니다. 기존 reward feedback 기반 분자 생성기는 utility 최적화에 치우쳐 다양성을 잃기 쉬운데, SGRPO는 set-level diversity를 직접 reward로 구성해 utility-diversity Pareto frontier를 확장합니다. 각 조건에서 후보 집합의 supergroup을 샘플링해 다양성을 비교하고, leave-one-out 기여도로 개별 rollout에 보상을 분배하는 방식입니다. de novo 소분자, pocket 기반 소분자, 단백질 디자인 태스크에서 GRPO 및 Coupled-GRPO와 결합해 평가했으며, decoding sweep에서 기존 대비 frontier-level metric이 가장 우수했습니다. 단, 작은 group size에서도 효과적이지만, generator나 diversity metric에 따라 성능 차이가 있을 수 있습니다. 코드는 공개되었습니다.

- #sgrpo

- #molecule-generation

- #diversity

- #reward-optimization

IDEA-XL

Papers·4일 전

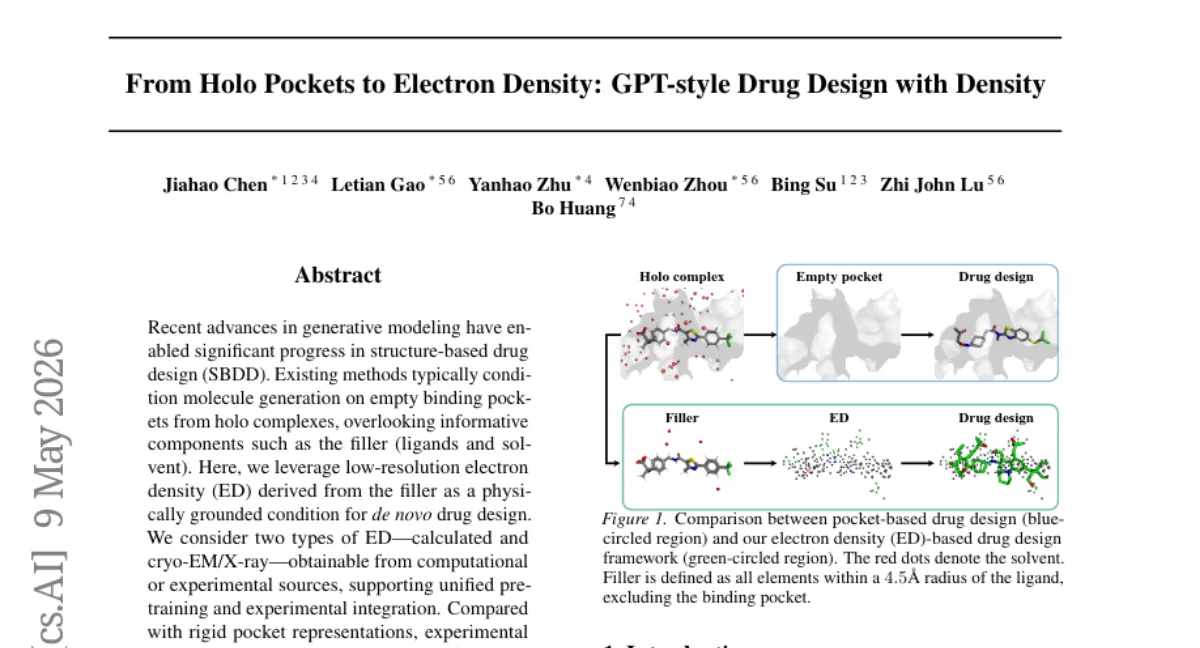

Papers·4일 전EDMolGPT — 저해상도 전자 밀도 맵으로 분자 생성, 101개 생물학적 타겟 검증

EDMolGPT는 저해상도 전자 밀도(ED)를 물리적 조건으로 활용하는 디코더-온리 자회귀 프레임워크로, 구조 기반 약물 설계(SBDD)에서 기존의 빈 포켓 조건 대신 충전물(리간드, 용매)의 ED를 사용해 분자를 생성합니다. 계산 ED와 실험(cryo-EM/X-ray) ED 모두를 지원해 통합 사전학습이 가능하며, 101개 생물학적 타겟 평가에서 효과를 입증했습니다. 다만, 저해상도 ED의 품질과 가용성이 실제 적용의 병목이 될 수 있습니다.

- #drug-design

- #generative-model

- #electron-density

- #edmolgpt

Jiahao Chen

Papers·4일 전

Papers·4일 전EleutherAI, 수학 연구 수준 추론 평가 벤치마크 Soohak 공개 — GPT-5 26.4%, 오픈웨이트 15% 미만

EleutherAI가 64명의 수학자가 직접 만든 439문제짜리 연구 수준 수학 벤치마크 Soohak을 발표했습니다. Challenge 서브셋에서 GPT-5가 26.4%, Claude-Opus-4.5가 10.4%를 기록했고, 오픈웨이트 모델들은 15% 미만으로 큰 격차를 보였습니다. 특히 모델이 부적절한 문제를 인지하고 추론을 중단하는 능력을 측정하는 refusal 서브셋에서 모든 모델이 50% 미만의 점수를 기록해, 새로운 최적화 목표를 제시합니다. 데이터셋은 오염 방지를 위해 2026년 말에 공개될 예정입니다.

- #benchmark

- #reasoning

- #mathematics

- #eleutherai

EleutherAI

Papers·4일 전

Papers·4일 전카자흐스탄 영화 리뷰 10만 건 공개 — mBERT, XLM-R이 감성 분류에서 BoW 대비 우세

카자흐스탄 영화 리뷰 플랫폼 kino.kz에서 2001~2025년 수집된 100,502건의 리뷰 데이터셋이 공개됐습니다. 주로 러시아어, 일부 카자흐어 및 코드 스위칭 텍스트로 구성되며, 감성 극성(3분류)과 평점(5분류) 태스크가 정의됐습니다. mBERT, XLM-RoBERTa, RemBERT 같은 트랜스포머 모델이 BoW/TF-IDF 기반 베이스라인보다 극성 분류에서 일관되게 나은 성능을 보였으나, 평점 분류는 클래스 불균형과 인접 등급 간 미세한 차이로 인해 여전히 어려운 과제로 남았습니다.

- #sentiment-analysis

- #multilingual

- #kazakhstan

- #dataset

Rustem Yeshpanov

Papers·4일 전

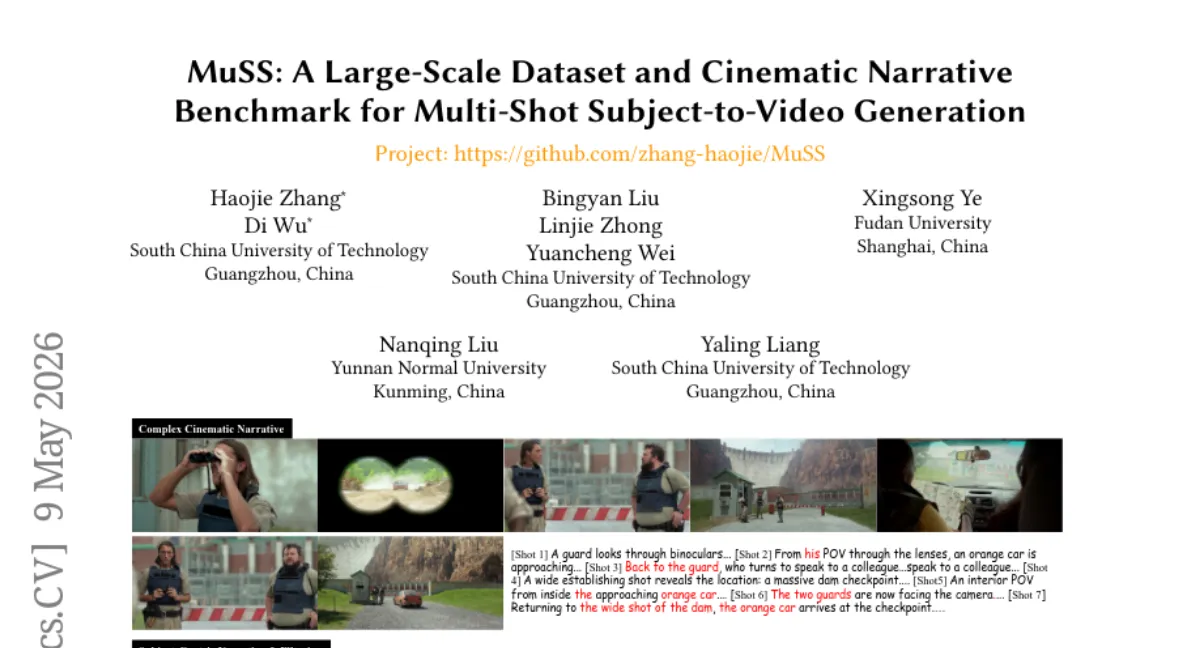

Papers·4일 전MuSS: 영화 3000편으로 구축한 멀티샷 비디오·S2V 데이터셋 — 서사 일관성과 복사-붙여넣기 문제 해결

MuSS는 3000편 이상의 영화에서 추출한 대규모 듀얼트랙 데이터셋으로, 멀티샷 비디오 생성과 Subject-to-Video(S2V) 생성을 동시에 지원합니다. 점진적 캡셔닝 파이프라인으로 로컬 정확도와 글로벌 서사 일관성을 확보하고, 교차샷 매칭 메커니즘으로 S2V의 '복사-붙여넣기' 쇼트컷을 원천 차단합니다. 제안된 Cinematic Narrative Benchmark와 Anti-Copy-Paste Variance(ACP-Var) 메트릭으로 평가한 결과, MuSS로 학습한 모델이 기존 기준선 대비 서사 효과와 신원 유지에서 SOTA를 달성했습니다. 다만 3D 구조 일관성 평가는 아직 초기 단계입니다.

- #video-generation

- #dataset

- #multi-shot

- #subject-to-video

Haojie Zhang

Papers·4일 전

Papers·4일 전MLS-Bench: AI가 일반화·확장 가능한 ML 방법을 스스로 발명할 수 있을까

Bohan Lyu 팀이 AI 시스템이 기존 방법을 적용하는 것을 넘어, 일반화·확장 가능한 ML 방법을 스스로 발명할 수 있는지 평가하는 벤치마크 MLS-Bench를 공개했습니다. 12개 도메인 140개 태스크로 구성되며, 현재 에이전트는 인간 설계 방법을 확실히 능가하지 못했고, 진정한 방법 발명보다 엔지니어링 튜닝에 더 강했습니다. 분석 결과, 병목은 새로운 방법 제안뿐 아니라 계획·검증·확장에 필요한 과학적 통찰력에 있으며, 단순히 검색·연산·컨텍스트를 늘리는 것으로는 해결되지 않습니다.

- #mls-bench

- #benchmark

- #agent

- #ml-methods

Bohan Lyu